Deepfake (deepfake, DF) არის ერთ-ერთი იმ ტექნოლოგიათაგანი, რომელიც, თუმცა შთამბეჭდავია, ხშირად გამოიყენება ბოროტი მიზნებისთვის და მათი პოპულარობა იზრდება. კომპანიები წლების განმავლობაში მუშაობდნენ რეალური ვიდეოს ამოცნობის გზებზე შეცვლილი ვიდეოდან, მაგრამ Intel-ის ახალი გადაწყვეტა, როგორც ჩანს, ერთ-ერთი ყველაზე ეფექტური და ინოვაციურია.

Deepfakes, რომელიც ჩვეულებრივ გულისხმობს ვინმეს სახის და ხმის სხვა ადამიანზე გადატანას, ყურადღება მიიპყრო რამდენიმე წლის წინ, როდესაც ზრდასრულთა ვებგვერდებმა დაიწყეს ვიდეოების აკრძალვა, სადაც ეს ტექნიკა გამოიყენებოდა ცნობილი მსახიობების სახეების დასამატებლად პორნოვარსკვლავების სხეულებზე.

მას შემდეგ DF-ვიდეოები უფრო და უფრო სრულყოფილი ხდება. არსებობს უამრავი აპი, რომელიც მომხმარებლებს საშუალებას აძლევს ჩასვან მეგობრების სახეები ფილმებში და ჩვენ ვნახეთ, რომ ხელოვნური ინტელექტი აცოცხლებს ძველ ფოტოებს და აცოცხლებს მსახიობების ახალგაზრდა ვერსიებს.

ასევე იყო აპლიკაცია, რომელიც შექმნილია ქალის ტანსაცმლის ციფრულად გადასაღებად. მაგრამ ყველაზე დიდი შეშფოთება არის ის, თუ როგორ გამოიწვია ღრმა ფეიქიმ დეზინფორმაციის გავრცელება - ამ წლის დასაწყისში სოციალურ ქსელებში გავრცელდა ყალბი ვიდეო უკრაინის პრეზიდენტის ვოლოდიმირ ზელენსკის დაჭერის შესახებ.

ორგანიზაციები, მათ შორის Facebook, თავდაცვის დეპარტამენტმა, Adobe-მ და Google-მა შექმნეს ინსტრუმენტები, რომლებიც შექმნილია ღრმა ფეიქების გამოსავლენად. მაგრამ Intel-ისა და Intel Labs-ის ვერსია, რომლის სახელიც სწორად არის FakeCatcher, იყენებს უნიკალურ მიდგომას: სისხლის ნაკადის ანალიზს.

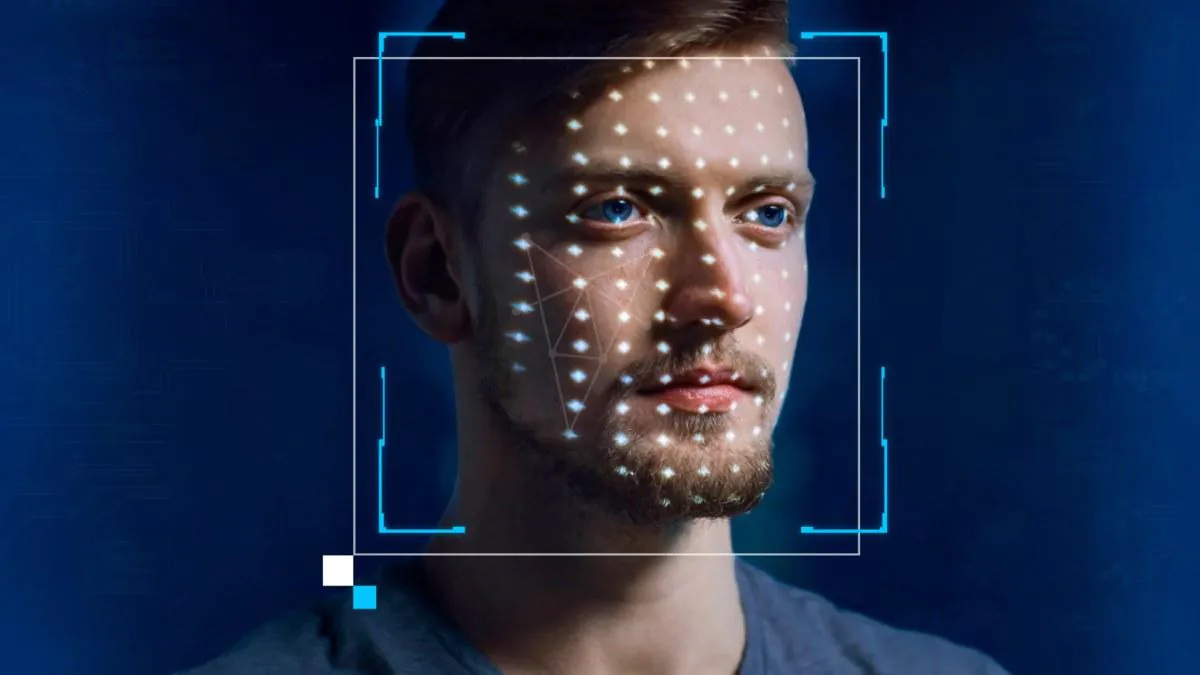

იმის ნაცვლად, რომ გამოიყენოს მეთოდი, რომელიც შეისწავლის ვიდეო ფაილს ფუნქციებისთვის, Intel-ის პლატფორმა იყენებს ღრმა სწავლებას ვენებში სისხლის ნაკადით გამოწვეული სახეების ფერის დახვეწილი ცვლილებების გასაანალიზებლად, პროცესს, რომელსაც ეწოდება ფოტოპლეტიზმოგრაფია ან PPG.

FakeCatcher აანალიზებს სისხლის ნაკადს სურათის პიქსელებში და სწავლობს სიგნალებს რამდენიმე კადრიდან. შემდეგ ის ხელმოწერებს გადასცემს კლასიფიკატორის მეშვეობით. კლასიფიკატორი განსაზღვრავს, არის თუ არა მოცემული ვიდეო რეალური თუ ყალბი. Intel-ი ამტკიცებს, რომ მზერაზე დაფუძნებულ გამოვლენასთან ერთად, ამ ტექნოლოგიას შეუძლია მილიწამებში და 96%-მდე სიზუსტით განსაზღვროს, არის თუ არა ვიდეო რეალური. კომპანიამ დაამატა, რომ პლატფორმა იყენებს მე-3 თაობის Xeon პროცესორებს 72-მდე ერთდროული აღმოჩენის ძაფების მხარდაჭერით და მუშაობს ვებ ინტერფეისის საშუალებით.

რეალურ დროში ასეთი მაღალი სიზუსტით გადაწყვეტამ შეიძლება დიდი განსხვავება შეიტანოს ონლაინ ომში დეზინფორმაციის წინააღმდეგ. მეორეს მხრივ, მას შეუძლია ღრმა ყალბი კიდევ უფრო რეალისტური გახადოს, რადგან ავტორები ცდილობენ სისტემის მოტყუებას.

თქვენ შეგიძლიათ დაეხმაროთ უკრაინას რუსი დამპყრობლების წინააღმდეგ ბრძოლაში. ამის საუკეთესო გზაა უკრაინის შეიარაღებული ძალებისთვის თანხების შემოწირულობა Savelife ან ოფიციალური გვერდის საშუალებით NBU.

ასევე საინტერესოა:

დატოვე პასუხი